ESET, compañía líder en detección proactiva de amenazas, explica qué son los rostros GAN y cómo esta tecnología basada en Inteligencia Artificial puede ser aprovechada por los cibercriminales para engañar a las personas.

Luego de analizar el potencial uso de tecnologías como ChatGPT por cibercriminales, ESET, compañía líder en detección proactiva de amenazas,continúa con la revisión de tecnologías que se desprenden de la IA, o más específicamente del Machine Learning, para ver qué son los rostros GAN y las posibilidades que ofrecen para fines maliciosos.

La tecnología GAN es un tipo de Inteligencia Artificial que permite crear rostros ficticios. Las redes GAN, (del inglés Generative Adversarial Network, cuya traducción puede ser redes generativas adversarias o antagónicas) son algoritmos que se basan en el Deep Learning. A través de esta tecnología se pueden generar rostros realistas y otro tipo de imágenes, incluso audios o videos. De hecho, estudios publicados ya daban cuenta a fines de 2021 que las imágenes creadas mediante Inteligencia Artificial son cada vez más convincentes y que existe un 50% de posibilidades de confundir un rostro falso con uno real.

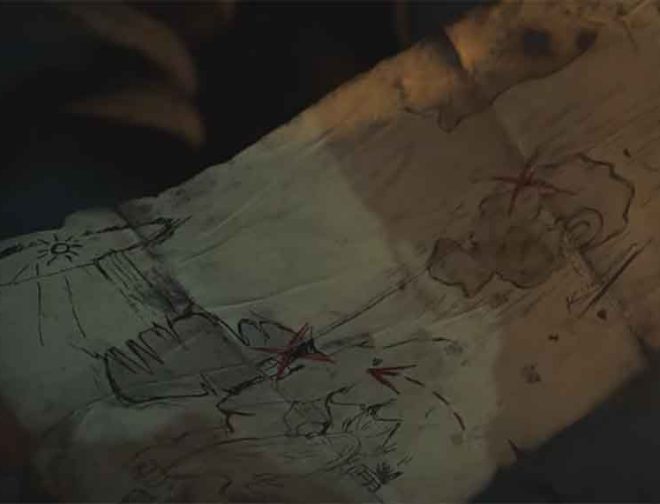

Ejemplo de un rostro GAN (izquierda) y un rostro real.

“Esta tecnología, que funciona en base al entrenamiento de imágenes, fue creada en el año 2014 por Ian Goodfellow y su equipo de colegas. Se necesita ingresar datos de entrada, como pueden ser rostros reales de diferentes personas, y el modelo ofrece como resultado nuevos rostros con nuevas características de apariencia real. Si bien los rostros GAN son de gran ayuda para industrias como la de los videojuegos para la generación de rostros para los personajes, o para efectos visuales que luego son utilizados en películas, también pueden ser utilizados con fines malintencionados”, comenta Camilo Gutiérrez Amaya, Jefe del Laboratorio de Investigación de ESET Latinoamérica.

En este sentido, ESET comparte algunos ejemplos de cómo esta tecnología puede ser utilizada por actores maliciosos:

Crear perfiles falsos

Si hay algo que los cibercriminales saben hacer es utilizar las nuevas tecnologías para poder desplegar estafas cada vez más persuasivas. Con las redes GAN pueden crear imágenes o incluso videos de personas conocidas, o no, para engañar a las víctimas y persuadirlas para que revelen información confidencial, como nombres de usuario y contraseñas, o hasta incluso los números de tarjetas de crédito. Por ejemplo, pueden crear rostros de personas ficticias que luego son utilizados para armar perfiles de supuestos representantes de servicio al cliente de una empresa. Estos perfiles luego envían correos electrónicos de phishing a los clientes de esa empresa para engañarlos y hacer que revelen información personal.

Crear fake news

El crecimiento de las fake news ha vuelto desafiante la tarea de discernir entre la información real y la falsa. Con el avance de las tecnologías de machine learning el desafío parece ir creciendo. Como se vio con ChatGPT y la posibilidad de crear una noticia falsa, si se acompaña esta noticia con videos o imágenes que se hacen pasar por personas reales, el potencial es enorme. Ya se han observado casos en los que se han creado deepfakes haciéndose pasar por políticos para distribuir fake news, como fue el caso del presidente de Ucrania, Volodymyr Zelensky, y un video falso que fue subido a sitios web comprometidos de este país en el que llamaba a los soldados ucranianos a bajar las armas.

Robo de identidad

La creación de rostros similares a los de personas públicas, como celebridades, puede facilitar los fraudes de robo o suplantación de identidad. Por ejemplo, hay que pensar en el reconocimiento facial como método de autenticación y las posibilidades que ofrecen los rostros GAN como instrumento para sortear este método de autenticación y acceder a la cuenta de un tercero. Por otra parte, también es importante mencionar que las empresas están al tanto de los riesgos y están desarrollando funcionalidades para detectar estas imágenes falsas.

Fraude en las aplicaciones de citas y redes sociales

Desde ESET ya se han mencionado los riesgos de seguridad y engaños que circulan entorno a los sitios y apps de citas. Pero con el avance de tecnologías como las redes GAN, los cibercriminales pueden crear rostros falsos que son utilizados para crear perfiles falsos en aplicaciones de citas y/o perfiles de redes sociales como parte de su estrategia para engañar y luego extorsionar a las víctimas. Compañías como Meta revelaron el aumento de perfiles falsos en los que se utilizaban imágenes artificiales creadas por una computadora.

Algunos consejos para evitar las estafas frente a la generación de imágenes y videos GAN son:

- Verificar la fuente: asegurarse de que la fuente de la imagen es confiable y verificar la veracidad de dicha imagen.

- “No todo lo que brilla es oro”: desconfiar de las imágenes que parecen demasiado perfectas. Mayormente las imágenes generadas por este tipo de tecnología tienen un aspecto perfecto y sin defectos, por lo que es importante desconfiar de ellas. Si una imagen o video parece sospechoso, buscar más información al respecto en otras fuentes confiables.

- Verificar las imágenes y/o videos: existen algunas herramientas como Google Reverse Image Search en línea que pueden ayudar a verificar la autenticidad de imágenes y videos.

- Actualizar los sistemas de seguridad: mantener los sistemas de seguridad al día para estar protegidos contra las estafas y el malware.

- Instalar un software antivirus de buena reputación: no solo ayudará a detectar código malicioso, sino a detectar sitios falsos o sospechosos.

- No compartir información confidencial: no compartir información personal o financiera con nadie que no conozcas.

“Si bien hoy estamos hablando sobre las redes GAN, los avances que se están dando dentro del campo de la IA son grandes, por eso recordamos que como usuarios debemos tratar de estar informados sobre las últimas técnicas utilizadas por los ciberdelincuentes para saber cómo protegernos de las distintas amenazas en línea”, destaca Gutiérrez Amaya, de ESET.